Depuis quelques années, les véhicules automatisés font l’objet de débats fréquents et prometteurs dans les milieux spécialisés. Aussi des comités d’experts nationales et internationales s’efforcent-ils à veiller à ce que l’utilisation en toute sécurité de tels véhicules dans le trafic routier ne soit non seulement possible, mais effectivement réalisée.

Toutefois, ces travaux n’attirent guère l’attention générale, probablement parce que les médias les considèrent pas assez intéressants pour le grand public[1], et préfèrent plutôt soulever des aspects spéculatifs de la conduite automatisée. Cela explique que leur approche est souvent hypothétique, parfois voire futuriste qui conçoit la conduite automatisée comme le signe annonciateur d’une substitution progressive de l’être humain par la machine. Ainsi les véhicules soi-disant « autonomes » – grâce à l’intelligence « artificielle »[2] qui met en œuvre une intégration sophistiquée de composants matériels et de logiciels – laissent à penser que les conducteurs deviendront bientôt obsolètes. Cette attitude est surtout promue par deux facteurs:

- d’une part, les départements marketing des constructeurs automobiles font croire dans leurs déclarations publiques que la percée à grande échelle des véhicules « autonomes » est imminente. A cet égard, ils oublient typiquement de mentionner que ces véhicules nécessitent toujours un conducteur à bord ou une surveillance à distance par une personne externe et qu’ils ne sont capables et autorisés de « se conduire d’eux-mêmes » que tem-porairement dans des conditions de circulation relativement restrictives (par exemple jusqu’à 60 km/h sur autoroute). En d’autres termes, les systèmes embarquées dans ces voitures ne suffisent de loin pas pour assurer une conduite véritablement « autonome » à savoir sans conducteur dans la voiture ni surveillance à distance, et ceci dans n’importe quelles conditions de circulation;;

- d’autre part, les milieux axés sur les technologies et les sciences naturelles emploient souvent un vocabulaire qui suggère que la combinaison de dispositifs matériels (machines, robots) et de logiciels (IA) donne naissance à un « ensemble intelligent », voire carrément à un « être intelligent » doté de qualités et capacités humaines ou même surhumaines. Ce langage imprudent attribue implicitement à ces systèmes la capacité de discerner et de décider, des sentiments et ressentis (à l’instar de la faim), voire de la rationalité, de la compréhen-sion et de la conscience[3].

Or, de telles déclarations passent sous silence que ces notions proviennent des sciences humaines et ont des significations et connotations peu adaptées pour décrire des objets inanimés. Aussi, au lieu d’informer et d’apporter de la clarté, ont-elles plutôt tendance à désinformer l’opinion publique.

En somme, des promesses trop optimistes faites dans les campagnes de marketing quant aux capacités techniques des véhicules automatisés ainsi que des analogies simplistes et bancales entre l’être humain et la machine contribuent à une image souvent biaisée et peu réaliste du niveau de développement de la conduite automatisée.

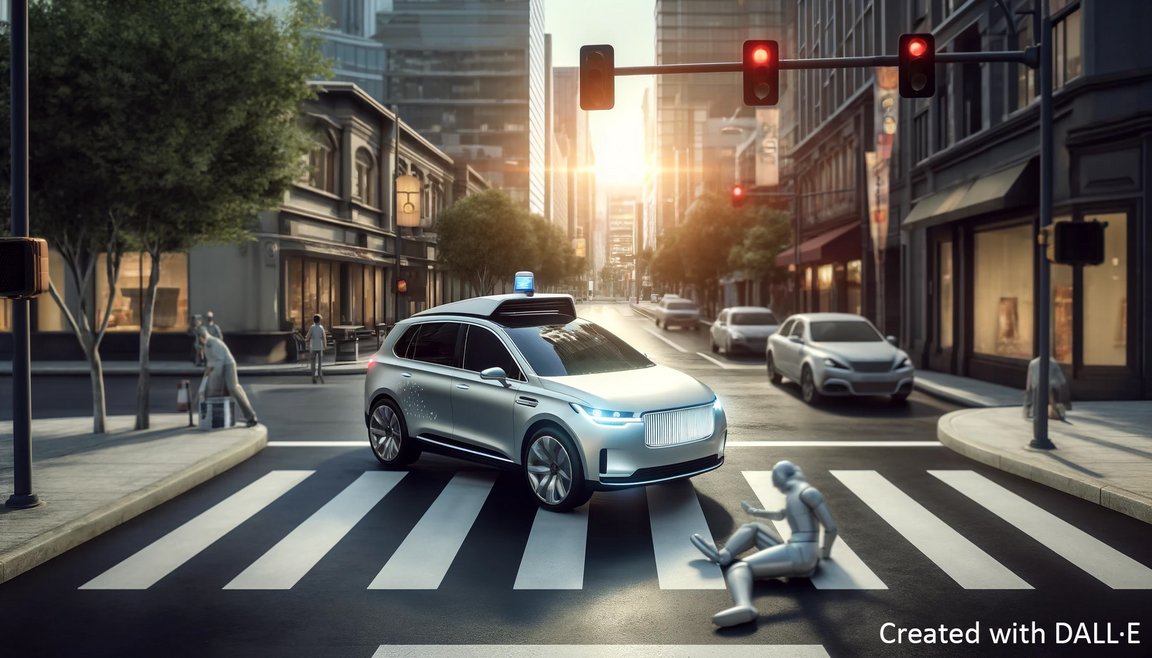

Cela va de pair avec un manque d’informations sur les capacités techniques des véhicules « autonomes » et les contraintes légales, d’un côté, et la tendance de spéculer sur des possibles scénarios d’accident et leurs conséquences hypothétiques, de l’autre côté. Est-ce qu’une voiture « autonome », qui n’arrive pas à s’immobiliser à temps devant un passage pour piétons, doit-elle renverser l’enfant ou la personne âgée traversant en même temps la route ? Tel est le genre de questions qui occupent et animent des débats publics.

Que faut-il penser de telles contributions médiatiques et dans quelle mesure contribuent-elles à une meilleure compréhension sociétale des avantages et inconvénients de la conduite automatisée ? La réponse à cette question peut se dégager des constatations et observations suivantes :

- Le dilemme éthique qui se pose lorsqu’il est question de déterminer si une voiture « autonome » doit plutôt renverser l’enfant ou la personne âgée sur un passage pour piétons ne procure aucun gain de connaissances permettant d’améliorer la compréhension de la conduite automatisée par la société. Au contraire, un tel dilemme génère de l’insécurité et alimente des peurs diffuses pour les raisons suivantes :

A) Premièrement, ladite situation de dilemme repose sur une hypothèse erronée car elle suppose qu’au moment où le conducteur, respectivement le véhicule « autonome » lui-même, et censé de choisir laquelle de deux personnes il convient de renverser, la réaction future des deux victimes potentielles soit connue. Or, tel n’est pas le cas. Le com-portement des deux piétons n’est ni déterminé ni déterminable à l’avance, vu qu’elles ont toutes deux la possibilité de s’arrêter ou de s’écarter instinctivement pour éviter in extremis la collision.

Par conséquent, celui qui entend devoir programmer à titre préventif – face à des comportements futurs inconnus des usagers de la route – des critères de décision pour la pesée des intérêts en cas d’accidents potentiels prend le risque de provoquer des accidents qui, sans son intervention, ne se seraient peut-être pas produits. C’est le cas lorsque – en réalité – un des piétons en danger a fait un saut sur le côté et que la voi-ture aurait pu passer par cet endroit sans provoquer d’accident.

B) Deuxièmement, la situation de dilemme est de nature spéculative et hypothétique et partant sans portée pratique pour la circulation réelle. Ainsi, la littérature et la jurisprudence ne font état d’aucun cas où la personne au volant aurait choisi, en son âme et conscience, entre écraser l’enfant ou la personne âgée sur le passage pour piétons et, par la suite, aurait eu à répondre en justice de son choix fait. Aussi, est-il difficile de voir pourquoi et comment ce scenario imaginaire devrait se convertir en un problème réel en cas d’emploi de véhicules automatisés.

C) Troisièmement, face au dilemme moral soulevé, l’éthique elle-même ne saura apporter aucune réponse concrète puisqu’elle s’interdit d’évaluer, de catégoriser ou de prioriser des vies humaines. En effet, faire un tel choix constituerait en soi déjà un acte immoral. A cela s’ajoute que de toute évidence des questions philosophiques insolubles ne sont pas propices à résoudre des problèmes de circulation routière concrets. - L’admission des véhicules à moteur à la circulation routière ainsi que la responsabilité en cas d’accidents sont régies par un ensemble complexe de règles de droit nationales, européennes et internationales ayant été élaborées pendant de nombreuses années.

Aussi des normes techniques et juridiques sont-elles déterminantes pour l’utilisation sûre des véhicules à moteur. Par contre, des considérations éthiques en termes de «bons» ou « mauvais » ne sont pas des éléments pertinents en matière de sécurité car il est demandé à la personne au volant d’adopter un comportement conforme à la législation et non pas une conduite philosophiquement et éthiquement irréprochable. Par conséquent, des consignes éthiques se révèlent pas opérationnelles vu qu’elles ne sont pas suffisamment justiciables pour imposer aux automobilistes des dommages-intérêts, des amendes ou voire des peines de prison. En d’autres termes, les automobilistes ne doivent pas être des personnes éthiquement « bonnes », mais des conducteurs qui respectent la loi. - Contrairement à une opinion largement répandue dont l’origine est peu claire, des accidents avec des véhicules automatisés ne présentent pas de défis de responsabilité fondamentalement nouveaux.

En pratique, les victimes d’accidents n’ont généralement aucun intérêt concret à réclamer des dommages-intérêts à l’automobiliste. En effet, elles peuvent faire valoir leurs dommages tout simplement directement contre le détenteur du véhicule, respectivement contre son assurance responsabilité civile, puisque le comportement du conducteur est imputable au détenteur. Par conséquent, en cas d’accident le fait de savoir si c’était le conducteur qui conduisait le véhicule ou si c’était le véhicule se conduisait de lui-même ne joue pratiquement aucun rôle pour la personne lésée.

Dans les deux cas, il appartiendra à l’assurance responsabilité civile de décider si elle veut se retourner contre le constructeur du véhicule pour se faire rembourser les dommages-intérêts versés à la victime lorsqu’il s’est avéré que l’accident était dû à un défaut du véhicule automatisé. Dans la mesure où un tel recours par l’assurance responsabilité civile à l’encontre du constructeur automobile devait aboutit, celui-ci pourra ensuite se retourner à son tour contre d’éventuels fournisseurs d’un composant défectueux. - Enfin pour ce qui est des poursuites pénales suite à un accident provoqué par un véhicule automatisé, qui temporairement s’était conduit de lui-même, l’élément déterminant sera de savoir si, compte tenu des circonstances concrètes, le conducteur dans la voiture ou la personne en charge de la surveiller à distance avait la possibilité raisonnable d’éviter l’accident provoqué par son véhicule automatisé.

Des véhicules sans conducteur et capables d’évoluer entièrement en mode autonome dans le trafic quotidien sans aucune surveillance humaine ne seront pas pour un avenir proche. Si de tels véhicules devaient un jour être autorisés à circuler sur nos routes, il y aura des accidents routiers entraînant des décès sans qu’aucune sanction pénale ne puisse être imposée au conducteur ou à la personne en charge de la surveillance.

Hélas, ce constat n’a rien de nouveau. À titre d’exemple, depuis longtemps notre société accepte bon gré mal gré que – en cas d’accident d’avion – un pilote suicidaire ayant entraîné ses passagers dans la mort ne peut pas être poursuivi en justice.

Il est donc inévitable que dans de rares situations on sera confrontés à des décès suite à des accidents avec des voitures autonomes sans qu’aucune sanction pénale ne puisse être imposée à quiconque. Toute technologie recèle certains risques et cela vaut également pour la conduite automatisée. Par conséquent, une société qui, par idéalisme ou ignorance, formule des exigences et attentes irréalistes à l’égard des véhicules automatisés, risque de « manquer le train » vers l’avenir de la conduite automatisée.